El machismo en la IA

Así señala la mujer de Bill Gate en una conferencia

Apenas una, de cada 10 científicos que trabajan en la inteligencia artificial son mujeres. ¿Cómo no pensar que sus creaciones no tengan un sesgo masculino?. Es lógico escuchar que su lenguaje y pensamientos, son masculinos; decía Melinda en su intervención.

Se ha hablado mucho de la ausencia de mujeres ingenieras y ejecutivas en el sector tecnológico. Pero la homogeneidad en la IA es un problema singular.

Este mes, Bill Gates subió al escenario en la conferencia Recode para hablar sobre filantropía con su esposa, Melinda. Hablaron sobre pagos móviles, contracepción, y multimillonarios que regalan sus fortunas. Luego la conversación pasó a la inteligencia artificial, y Gates sonrió y giró en su silla de cuero rojo. “Es el Santo Grial. Es el gran sueño imaginado por todos los que han estado en la informática”.

Melinda French esperó pacientemente a que su marido terminara de enumerar las virtudes de las máquinas capaces de resolver problemas sin que los científicos las programen para conocerlos. A continuación le tocó a ella: “Lo que quiero decirles a todos en esta sala es: debemos preocuparnos por las mujeres que están en la informática”, dijo. “Es bueno que las mujeres participemos en todas estas cosas porque es bueno un entorno diverso para crear la IA y las herramientas tecnológicas y todo lo que vamos a usar”. Señaló que sólo 17 por ciento de los egresados de la carrera informática son actualmente mujeres, por debajo de un pico de 37 por ciento.

Las cifras son, en realidad, peores. En una de las mayores conferencias sobre inteligencia artificial de 2015 –NIPS, realizada en Montreal- sólo 13.7% de los asistentes fueron mujeres, según datos que los organizadores de la conferencia comunicaron a Bloomberg.

No resulta tan sorprendente, teniendo en cuenta las pocas mujeres que hay en este campo, dijo Fei-Fei Li, que dirige el laboratorio informático de la visión en la Universidad de Stanford. De los 15 científicos en el laboratorio de IA de Stanford, Li es la única mujer. También es una de las únicas cinco mujeres profesoras de informática en la universidad. “Si usted fuera una computadora y leyera todos los artículos sobre IA y tomara los nombres que aparecen citados, le garantizo que rara vez aparecerían mujeres”, dijo. “Por cada mujer citada en el área de tecnología de AI, fueron citados cien veces más hombres”.

Se ha hablado mucho de la ausencia de mujeres ingenieras y ejecutivas en el sector tecnológico. Pero la homogeneidad en la IA es un problema singular. Para enseñarles el mundo a las computadoras, los científicos deben reunir conjuntos de datos masivos prácticamente acerca de todo. Para aprender a identificar las flores, es necesario alimentar a una computadora con decenas de miles de fotos de flores para que cuando vea una foto de un nardo bajo una luz débil, pueda recurrir a su experiencia y averiguar qué está viendo.

Si estos conjuntos de datos no son lo suficientemente amplios, las compañías pueden crear IA con sesgos. Un software de reconocimiento de voz con un conjunto de datos que sólo contenga a personas que hablan un correcto inglés británico artificial tendrá dificultades para entender el argot y la dicción de alguien proveniente de una ciudad del interior estadounidense. Si todos los que enseñan a las computadoras a actuar como humanos son hombres, las máquinas tendrán, de manera predeterminada, una visión del mundo estrecha y, a través de la salvaguarda de las series de datos, posiblemente sesgada.

“Yo lo defino como un mar de tipos”, dijo Meg Mitchell, investigadora en Microsoft. Mitchell trabaja en visión por computadora y problemas del lenguaje, y es una de las fundadoras –y la única científica mujer- del grupo de “cognición” de Microsoft. Ha trabajado, calcula, con alrededor de 10 mujeres en los últimos cinco años, y cientos de hombres. “Estoy convencida de que el género tiene un efecto en las clases de preguntas que hacemos”, dijo. “Nos estamos poniendo en una posición de miopía”.

Ya ha habido incidentes vergonzosos debido a conjuntos de datos incompletos o defectuosos. Google desarrolló una aplicación que erróneamente etiquetaba a las personas negras como gorilas y Microsoft inventó un bot conversacional que en definitiva reflejaba las inclinaciones de lo peor que internet tenía para ofrecer.

- Racing Campeón

Con la derrota del aurinegro ante los bohemios, la escuelita

Con la derrota del aurinegro ante los bohemios, la escuelita - Defensor Sporting 1 – Progreso 0

En el Estadio Franzini, con gol del juvenil Nicolás Wunsch,

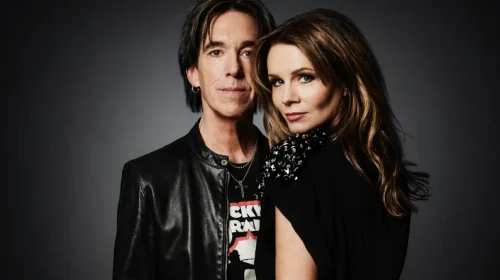

En el Estadio Franzini, con gol del juvenil Nicolás Wunsch, - Roxette: 40 años con canciones inolvidables

La noche del 18 de abril de 2026 en Antel

La noche del 18 de abril de 2026 en Antel - Nikonov: policía discapacitado

El policial clásico encuentra una vuelta de tuerca en Nikonov,

El policial clásico encuentra una vuelta de tuerca en Nikonov, - Sanciones, deuda y bloqueo: el nuevo rostro del viejo imperio

No hacen falta ejércitos ni banderas extranjeras clavadas en la

No hacen falta ejércitos ni banderas extranjeras clavadas en la

“Desde el punto de vista del aprendizaje de máquinas, si pensamos en la inclusión de género, muchas veces las inferencias que se hacen están sesgadas hacia el grupo mayoritario –en este caso, los varones blancos ricos”, dijo Margaret Burnett, profesora en la Escuela de Ingeniería Eléctrica e Informática de la Universidad de Oregón. Burnett desarrolló GenderMag, que ayuda a los programadores de software a desarrollar sistemas que tengan en cuenta las diferencias de género de sus usuarios. Microsoft viene experimentando con ese software, dijo. También ha investigado cómo sufren los sistemas de aprendizaje de máquinas si los diseñadores no tienen en cuenta el género. “Si se introduce material no diverso, salen resultados estrechos de miras, convencionales y no muy buenos”, dijo.

Tay, el bot conversacional que Microsoft lanzó este año, contenía un montón de material no diverso. Dentro de las primeras 24 horas de ser expuesto al público, Tay asumió una personalidad racista, sexista y homofóbica. Lo hizo porque los usuarios de internet se dieron cuenta de que Tay aprendería de sus interacciones, de modo que tuitearon cosas insultantes, racistas y desagradables. Tay incorporó ese lenguaje a su modelo mental y comenzó a vomitar más de lo mismo.

Compañías como Microsoft tienen dificultades a la hora de armar conjuntos de datos mejores y más diversos. “¿Cómo podemos garantizar que los conjuntos de datos que utilizamos para entrenar piensen en el género?” preguntó Lili Cheng, que encabezó el grupo de Microsoft que desarrolló Tay. “La industria en su conjunto, incluidos nosotros, debe clasificar mejor tanto el género como otras señales de diversidad en los conjuntos de datos de entrenamiento”.

Ya existen pruebas de que la disparidad de género penetró en los anuncios de empleo para IA. Textio es una empresa emergente que ayuda a las empresas a cambiar el vocabulario de los anuncios de empleo con el fin de aumentar la cantidad y la diversidad de los postulantes. Realizó un análisis de 1,700 avisos de empleo en IA y los comparó con más de 70,000 anuncios diseminados en otras seis funciones típicas de TI. El análisis demostró que los anuncios de empleo de IA tienden a estar escritos de un modo muy masculino en relación a otros trabajos.

“Cada uno tiene algo de sesgo”, dijo Katherine Heller, directora ejecutiva de Women in Machine Learning, un grupo que lleva una década abocado a mejorar la diversidad de género en IA. La entidad organiza charlas y presentaciones con mujeres científicas, y también tiene una guía pública en la que aparecen varios cientos de mujeres que trabajan en aprendizaje de máquinas, permitiendo acceder a las mujeres de esa comunidad.

Algunas mujeres en IA se concentran en la próxima generación. Li, de Stanford, creó un grupo para chicas de 15-16 años llamado SAILORS que aúna el estudio intensivo con excursiones a empresas y asesoramiento. No queriendo desaprovechar la oportunidad de hacer una investigación, Li realizó un estudio del programa y constató que en las mujeres que lo habían seguido se produjo un aumento significativo del conocimiento técnico, la confianza y el interés en seguir carreras relacionadas con la IA. Chelsea Finn, estudiante de doctorado en la Universidad de California en Berkeley, dijo que lo más útil para ella es tener modelos femeninos visibles.